Intelligent Computed Tomography-based Detection Method for Lithium Battery Mylar Film Damage

-

摘要:

近年来,随着锂电池行业的快速发展与技术创新,电池的安全性能检测变得愈发重要。Mylar膜作为锂电池组装的重要组成部分,能极大地提升锂电池的使用安全性。然而,针对Mylar膜的破损检测研究却鲜有开展。因此,本文创新性地提出一种基于CT扫描的锂电池Mylar膜破损智能检测方法。该方法借助CT扫描这一无损检测技术,精准获取锂电池内部信息;随后结合图像预处理技术与深度学习算法,构建智能检测模型,实现对缺陷电池的高效、精准检测。实验结果表明,该方法对Mylar膜破损缺陷具有高检出率和低误检率,具有较高的应用价值。

-

关键词:

- 锂电池Mylar膜 /

- 缺陷检测 /

- Retinex图像增强 /

- 图像分类

Abstract:With the rapid development and innovation of the lithium battery industry in recent years, battery safety performance testing has become increasingly important. As an essential component of lithium batteries, Mylar films can significantly improve the safety of lithium batteries. However, few studies have focused on damage detection in Mylar films. To address this issue, this study developed an innovative intelligent detection method for lithium battery Mylar film damage. This method utilizes computed tomography (CT) nondestructive testing technology to accurately obtain internal information on lithium batteries. Subsequently, by combining image-preprocessing techniques and deep learning algorithms, an intelligent detection model was constructed to efficiently and accurately detect defective batteries. Experimental results demonstrate that the proposed method achieves a high detection rate and low false-detection rate for Mylar film defects, highlighting its significant potential for practical applications.

-

锂电池因其高能量密度、环保性和低污染等特点,已成为现代电子产品、电动汽车及储能系统的核心动力来源。其性能优势源于独特的电化学体系设计,而结构安全性更是决定其大规模应用的关键因素。

在锂电池的结构中,电芯包覆

Mylar 膜(一种聚酯纤维制成的薄膜材料),可有效阻隔正负极直接接触导致的内部短路,同时抑制电解液挥发与活性物质迁移,减少电池内部物质泄漏,从而显著提升电池的安全性与使用寿命[1]。在制造方形锂电池的过程中,裸电芯在装入铝壳之前需要由Mylar 膜包裹[2-3]。然而,由于机械加持、外力撞击等生产环节中的技术因素,Mylar 膜可能发生破损,进而导致电池容量下降、内压增大以及安全性能降低[4]。然而目前的Mylar 膜检测方法仍以传统人工检测为主,已无法满足高速产线的检测需求[5],因此,亟需一种针对Mylar 膜破损的检测方法。目前,针对

Mylar 膜缺陷检测的研究已有一定进展。2022年王卓等[6]利用不同的参数设置阈值分割得到连通区域后对Mylar 膜进行缺陷检测。同年,其他学者[7]提出了一种Mylar 膜检测方法和检测系统,通过抓取移送、图像采集等模块检测Mylar 膜是否脏污、贴胶不牢等。但这些方法主要依赖于光学成像技术,无法直接获取电池内部的详细信息,难以全面检测Mylar 膜的破损情况。基于

X 射线成像的CT 重建技术近年来已被广泛应用于失效分析等领域,能够对锂电池内部进行无损3D 成像[8-10]。葛春平等[11]曾针对叠片电池提供了一种基于法向叠加的重建方法,降低了快速CT 重建图像的噪声水平,由于Mylar 膜是一种低密度薄膜材料,其在三维断层图像上叠加容易受到极片灰度值的干扰,此方法并不适用于Mylar 膜破损的精确检测。目前,X 射线CT 成像技术是对入壳后电芯的Mylar 膜缺陷检测唯一有效的方法,快速检测Mylar 膜的相关算法鲜有发表。近年来,深度学习在缺陷检测等领域发挥着关键作用。图像分类网络如

AlexNet [12]、VGGNet [13]、GoogLeNet [14]、ResNet [15]、DenseNet [16]和ViT [17]等,通过学习图像特征,能够有效区分缺陷图像与正常图像。FasterR-CNN[18]、YOLO [19-21]等目标识别算法专注于识别图像中的缺陷区域,以此完成缺陷检测任务。对于需要像素级精度的检测任务,UNet [22]、SegNet [23]和PSPNet [24]等模型将检测任务转化为图像分割任务,实现了对缺陷区域的高精度分割。鉴于深度学习在缺陷检测应用的优势,本文提出一种针对锂电池

Mylar 膜破损的智能检测方法。首先利用锥束CT 对锂电池进行扫描成像,获得清晰的切片图像;然后,对图像进行对比度增强处理;最后,结合深度学习技术实现锂电池Mylar 膜破损缺陷的快速自动检测。实验结果表明,本方法对

Mylar 膜破损的缺陷具有高检出率和低误检率,检测效率显著提升,为锂电池Mylar 膜破损检测提供一种高效可靠的技术方案。1. Mylar膜破损的缺陷检测方法

由于

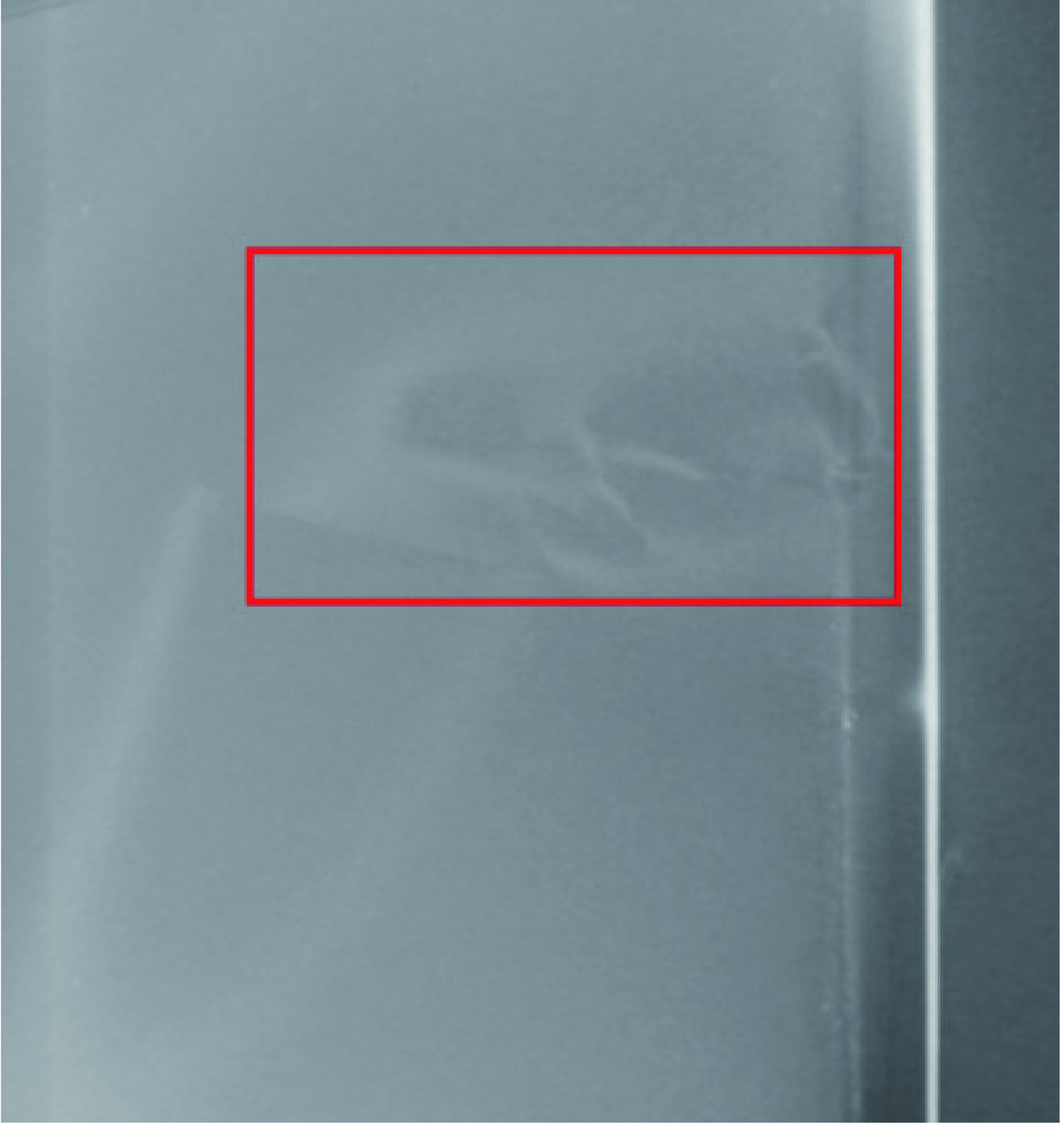

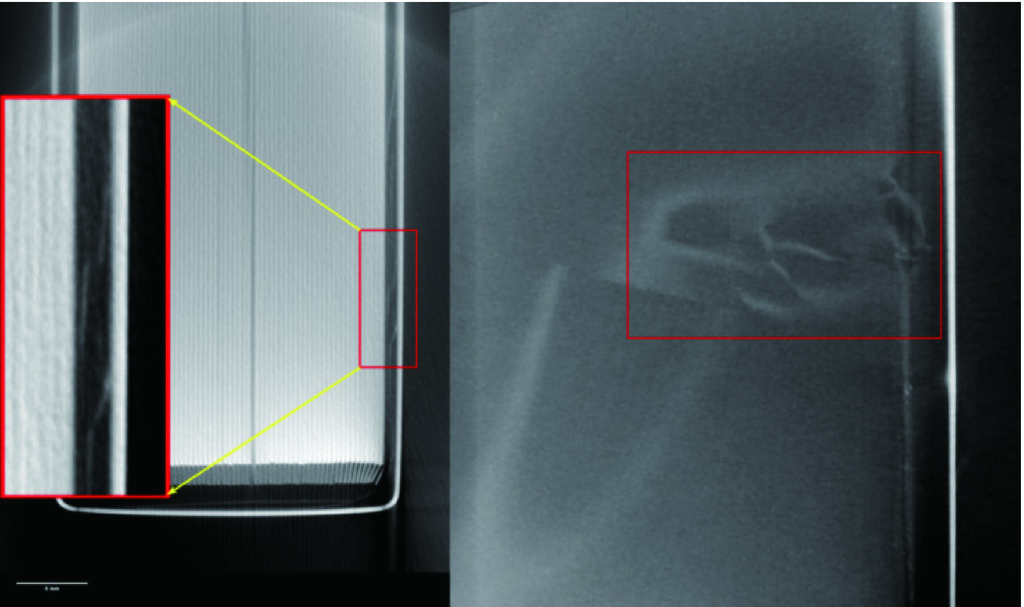

Mylar 膜位于方形铝壳电池内部,采用拆解表征的方法不仅会对电池本体造成不可逆的破坏,而且难以判定Mylar 膜破损是源于拆解过程还是电池本身存在的缺陷。为了解决这一问题,本文利用X 射线CT 扫描技术,通过对锂电池不同角度进行图像采集并经三维重建算法处理,获得了高分辨率的断层图像(图1)。尽管

CT 图像能够清晰呈现出Mylar 膜破损的部位,由于重建后的切片数量庞大,直接定位实际缺陷位置仍面临挑战。通过对三维重建图像进一步分析发现,在垂直于Mylar 膜方向的侧面切片中,由于视角与薄膜垂直,缺陷特征不明显;而在平行于Mylar 膜的大面切片中,破损特征信息较为丰富。基于这一发现,本文提出一种Mylar 膜破损的智能检测算法,具体步骤如表1所示,整体检测流程见图2。表 1Mylar 膜破损的智能检测算法Table 1. Intelligent detection method forMylar film damage算法 1 Mylar膜破损的智能检测算法 1: 数据采集与重建:利用X射线CT扫描系统对锂电池进行扫描,采集投影图像序列,并通过三维重建算法得到高精度三维断层图像。 2: 切片提取与预处理:从断层图像中提取平行于Mylar膜方向的大面切片图像。对所选切片进行图像预处理,包括数据量化、对比度增强等操作,以突出Mylar膜破损特征。 3: 深度学习分类:基于预处理后的切片图像,选择神经网络进行特征提取和分类。 1.1 数据预处理——图像增强

虽然经过

CT 重建后的断层图像上已经可以看到Mylar 膜的破损部位,但对于图像识别或分类任务而言,破损部位的特征表现并不明显,无论是人工检测或是机器识别都较为困难。为了提高破损特征的可识别性,需要对图像进行增强处理。Retinex 理论是Land等[25]提出的一种图像增强算法,通过对图像中的每个像素的周围像素亮度加权平均,来调整图像亮度并增强细节。该理论可以有效地提升图像对比度,突出局部特征。在此基础上,研究人员又相继提出了单尺度Retinex 、多尺度Retinex 等改进方法,进一步提高了增强效果。考虑到断层图像的特点及破损特征的尺度差异,本文采用Belén团队提出的MSR(multi-scale retinex) 方法[26]对重建图像的每层切片进行对比度增强,该算法的伪代码如表2所示。

表 2 MSR对比度增强算法Table 2. MSR contrast enhancement algorithm算法 2 MSR(Multi-Scale Retinex)对比度增强算法 输入:图像I(x,y),高斯函数的尺度参数σ1,σ2,⋯,σN。 输出:对比度增强后的图像Ienhence(x,y)。 1. 对数域变换:I′(x,y)=logI(x,y)。 2. Ln(x,y)=Gn(x,y)∗I′(x,y),(n=1,2,⋯,N)。 3. Rn(x,y)=I′(x,y)−Ln(x,y)。 4. R(x,y)=∑Nn=1wnRn(x,y),其中∑Nn=1wn=1。 5. Ienhence(x,y)=RESIZE(exp(R(x,y)))。 注:Ln(x,y)为光照分量的估计值,Gn(x,y)为不同尺度σn的高斯函数,Rn(x,y)为每个尺度下的反射率估计值。RESIZE(⋅)为线性拉伸算子,第5步表示对R(x,y)进行指数变换并线性拉伸至原始图像范围得到对比度增强后的图像Ienhence(x,y)。 经过

Retinex 增强后的图像上Mylar 膜的破损部位对比度有明显提升(如图3和图4红框内所示),此时,人工已经可以轻易地辨别出Mylar 膜是否破损,同时,这也将十分有助于后续的自动检测任务。1.2 深度学习分类

针对

Mylar 膜的破损检测需求,判断样本是否破损是检测的主要目标,而样本的具体破损位置并不是很重要,因此本文采用图像分类方法进行检测。为简化问题并降低人工标注成本,本文采用二分类策略,将样本分为破损的Mylar 膜和其他类别(包括正常的Mylar 膜、极片、空气等)。然而,破损的Mylar 膜样本量不足3%,这在图像分类任务中属于极度不均衡问题。针对这一问题,本文采用两种数据层面的解决策略:(1)通过随机旋转、裁切等方式进行数据增强;

(2)对破损的样本进行过采样来扩充数据集。

在对训练集的数据进行扩充和增强后,考虑到重建图像尺寸存在大小不一的问题,本文选用经典的

ResNet 作为分类器,ResNet 中的全局平均池化层能够处理任意尺寸的输入数据,这一特性非常适合本文重建图像尺寸可能不一致的问题。ResNet 中的残差连接也十分有助于模型的收敛,通过修改最后一层全连接层以适应二分类任务,模型架构图如图5所示。为了提升模型在小样本数据下的泛化能力,本文引入迁移学习策略,这种策略已被广泛证明能有效提升深度学习模型在小数据集上的表现[27-29]。本文基于在大规模数据集(

ImageNet )上预训练的深度卷积神经网络模型进行特征迁移与微调后,再应用于Mylar 膜破损检测任务,大大减少了训练时间和对大规模标注数据集的依赖。2. 实验

2.1 数据集构建

首先,对锂电池进行三维锥束

CT 成像。如图6所示,将电池样品置于旋转台上,X 射线源到旋转中心的距离为100 mm,X 射线源到探测器的距离为545 mm,探测器成像面积307.2 mm×307.2 mm,具体扫描及重建条件如表3所示。表 3 锂电池CT 扫描重建条件Table 3. CT scanning and reconstruction conditions for lithium batteries参数名称 参数值 电压 150 kV 电流 400 μA 曝光时间 0.05 s 帧间合并数 6 扫描角度 360° 扫描角度间隔 0.2° 探测器单元尺寸 0.15 mm×0.15 mm 探测器单元个数 2048 ×2048 射线源到旋转中心的距离 100 mm 射线源到探测器的距离 545 mm 重建图像尺寸 27.5 μm×27.5 μm×27.5 μm 重建图像体素个数 1140 ×1448 ×1536 通过重建软件的预重建功能选择感兴趣区域(region of interest,ROI),将锂电池的大面平行于视角摆正后,经

FDK [30]算法重建获得锂电池的三维断层图像,这样选择ROI 后,三维断层图像的每层二维图像即待处理的锂电池大面上的2D 切片图像。然后,利用

MSR 算法进行图像对比度增强。在将重建图像量化到[0,255]后,取3个尺度的高斯核sigmas=[12,80,250]处理,鉴于原始重建图像的尺寸较大,这对模型训练和检测的硬件计算能力要求较高,因此采用双线性插值法将图像降采样至483×512 像素后再处理。同时由于实际重建断层为灰度图像,应用MSR 图像增强时仅针对单通道处理即可,这将单张图像的平均处理时间从原来的1 s左右降低至0.3 s左右,对比度增强保存后再作为模型的输入。将2套扫描数据用于训练,1套扫描数据用于验证,1套扫描数据用于测试,并在模型训练阶段,对样本数据进行50%垂直翻转、50%水平翻转、±15°旋转数据增强。在训练集上对破损样本进行30倍过采样,详细数据集见表4。

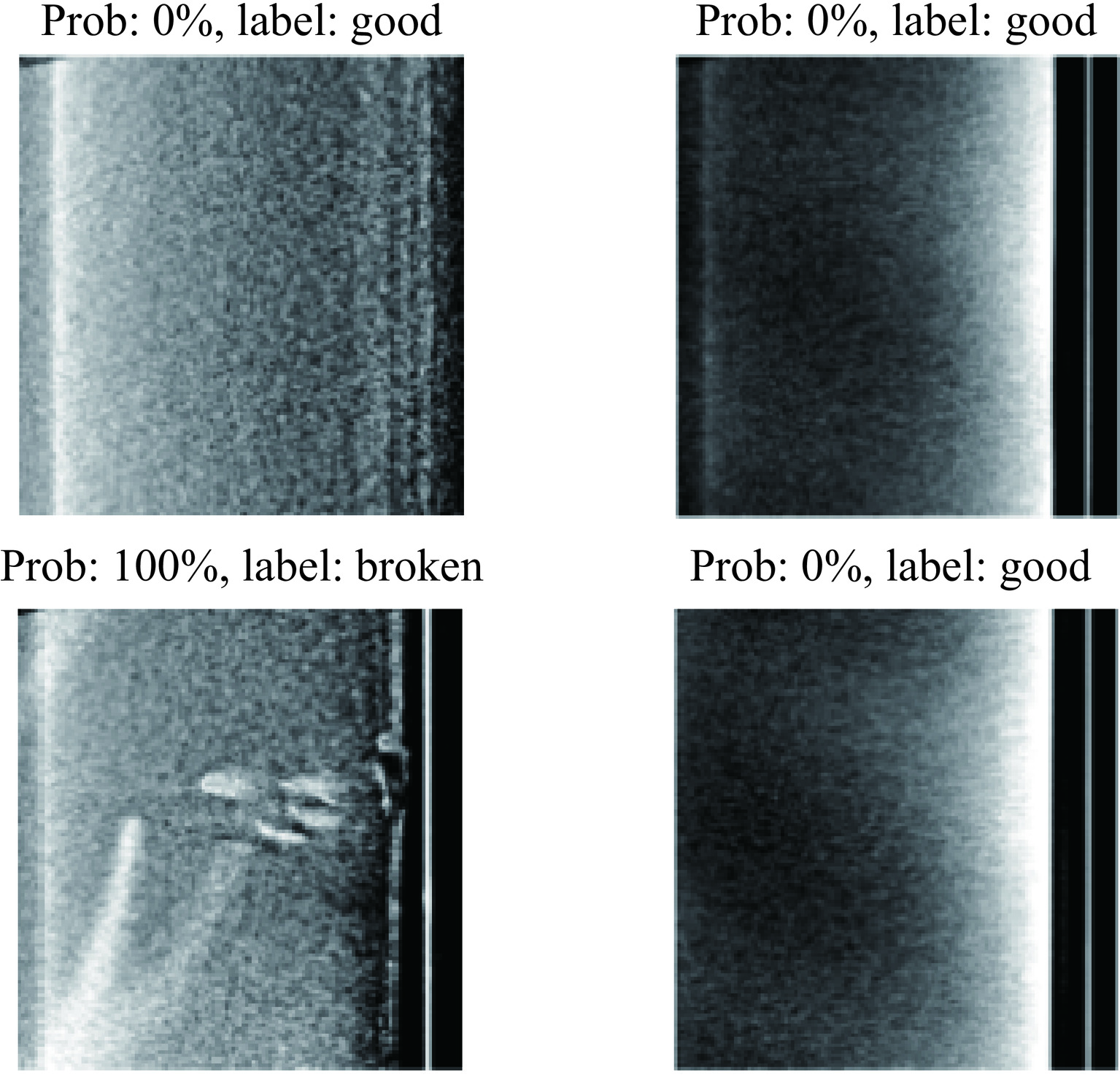

表 4 数据集信息Table 4. Dataset information项目 训练集 验证集 测试集 总计 图像总数量 760 380 380 1520 破损样本数量 12 6 6 24 过采样的破损样本数量 360 60 0 420 部分训练样本及标签如图7所示,其中正常样本标签为

0 ,破损样本标签为1 。2.2 模型训练及结果

本文实验在

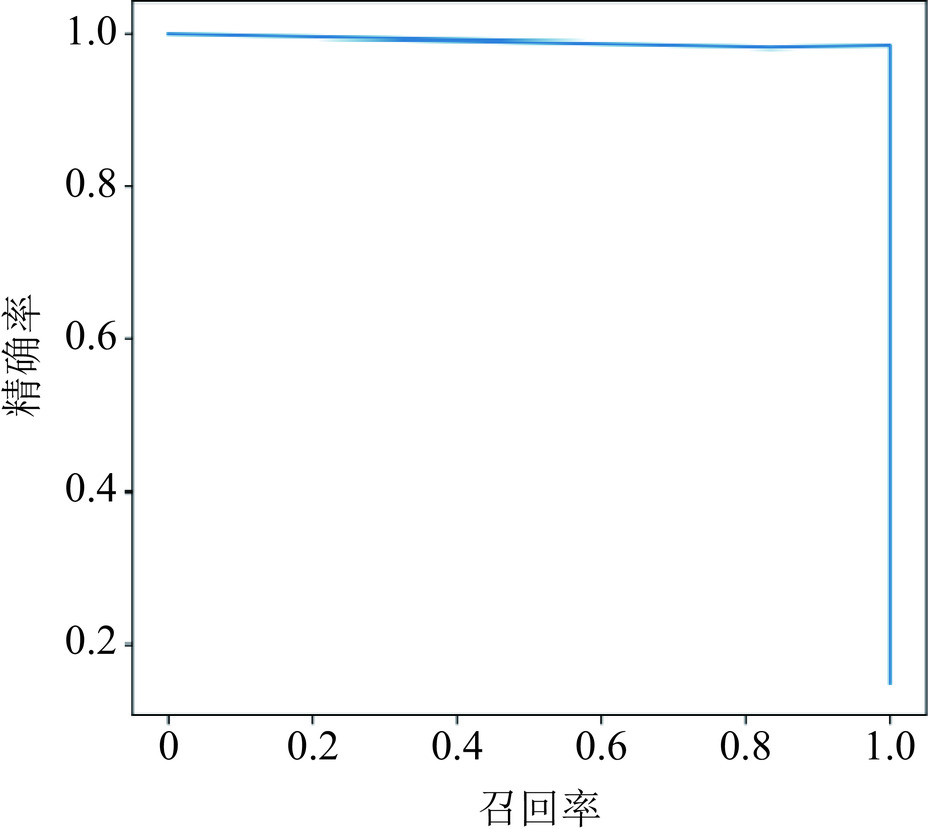

Windows 环境下进行,所有实验运行的硬件配置为AMDRyzen95950x 处理器,显卡为NVIDIARTX 3080Ti ,CUDA 版本为12.6,软件环境为Pytorch2.3.1 框架,编程语言为python3.12 。ResNet34 模型首先加载在ImageNet 数据集上预训练的权重参数,再对数据增强后的训练集进行训练,同时选择交叉熵作为损失函数,主要训练参数设置如下:epoch 为100 ,batchsize 为32 ,优化器为AdamW ,初始学习率为0.001 ,初始化随机种子为10010 。学习率调度器根据验证集的交叉熵损失函数动态调整,当损失值在5 个epoch 内没有改善时学习率降低0.2 倍,最小学习率为1×10−10。模型收敛后,仅对测试集图像进行对比度增强处理后再进行图像分类,在测试集上的PR(precision-recall)曲线如图8所示。

PR 曲线下方几乎已经完全包裹[0,1]×[0,1] 区域,这表明该分类结果具有高精确率(Precision)和高召回率(Recall) ,即模型对Mylar 膜破损的缺陷具有高检出率和低误检率。同时,模型对于正确分类破损Mylar 膜与其他图像的准确率(Accuracy)已达到99.5%以上,我们选择部分预测结果并绘制图像如图9所示,这也与准确率结果表现相符。3. 讨论

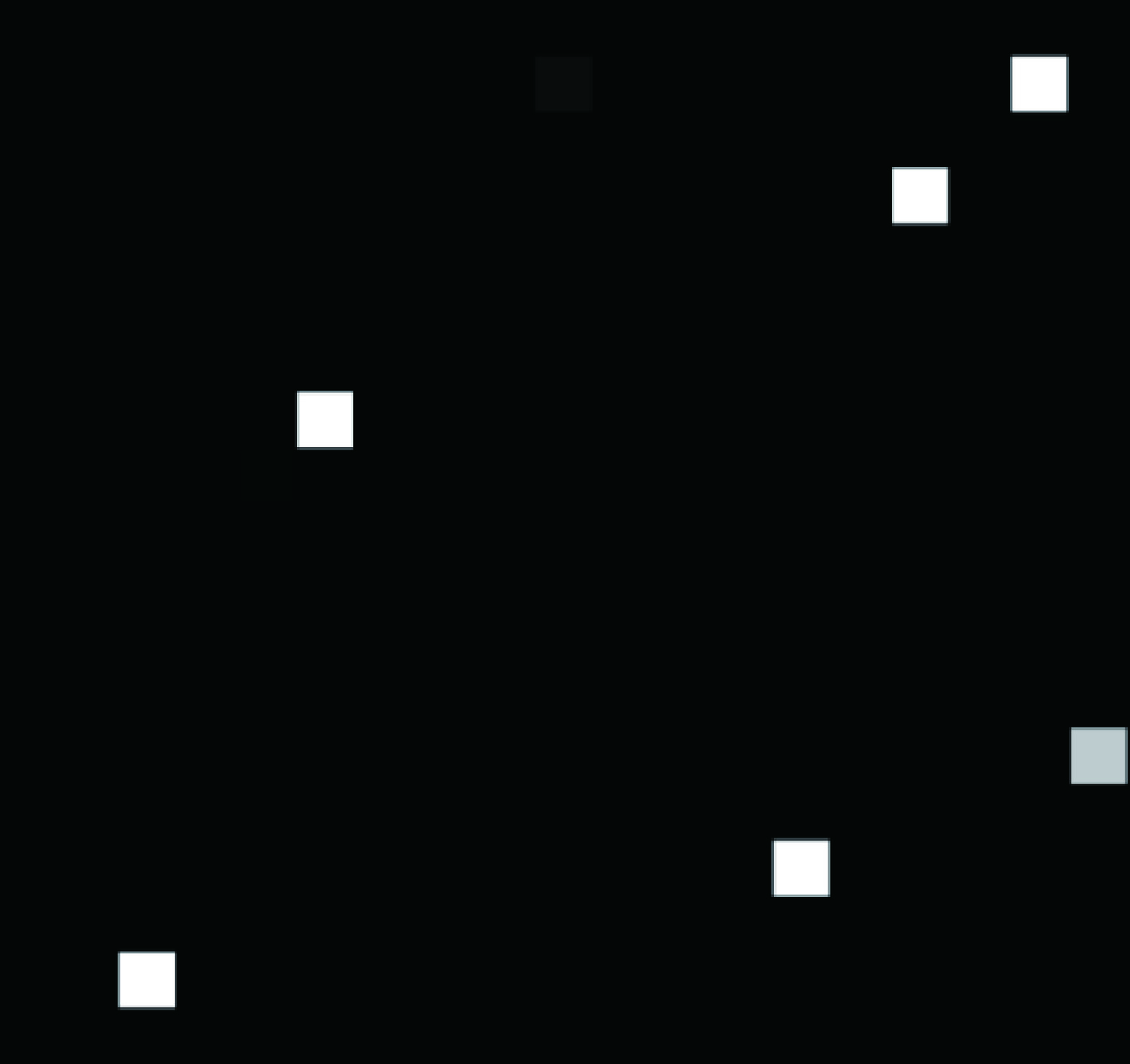

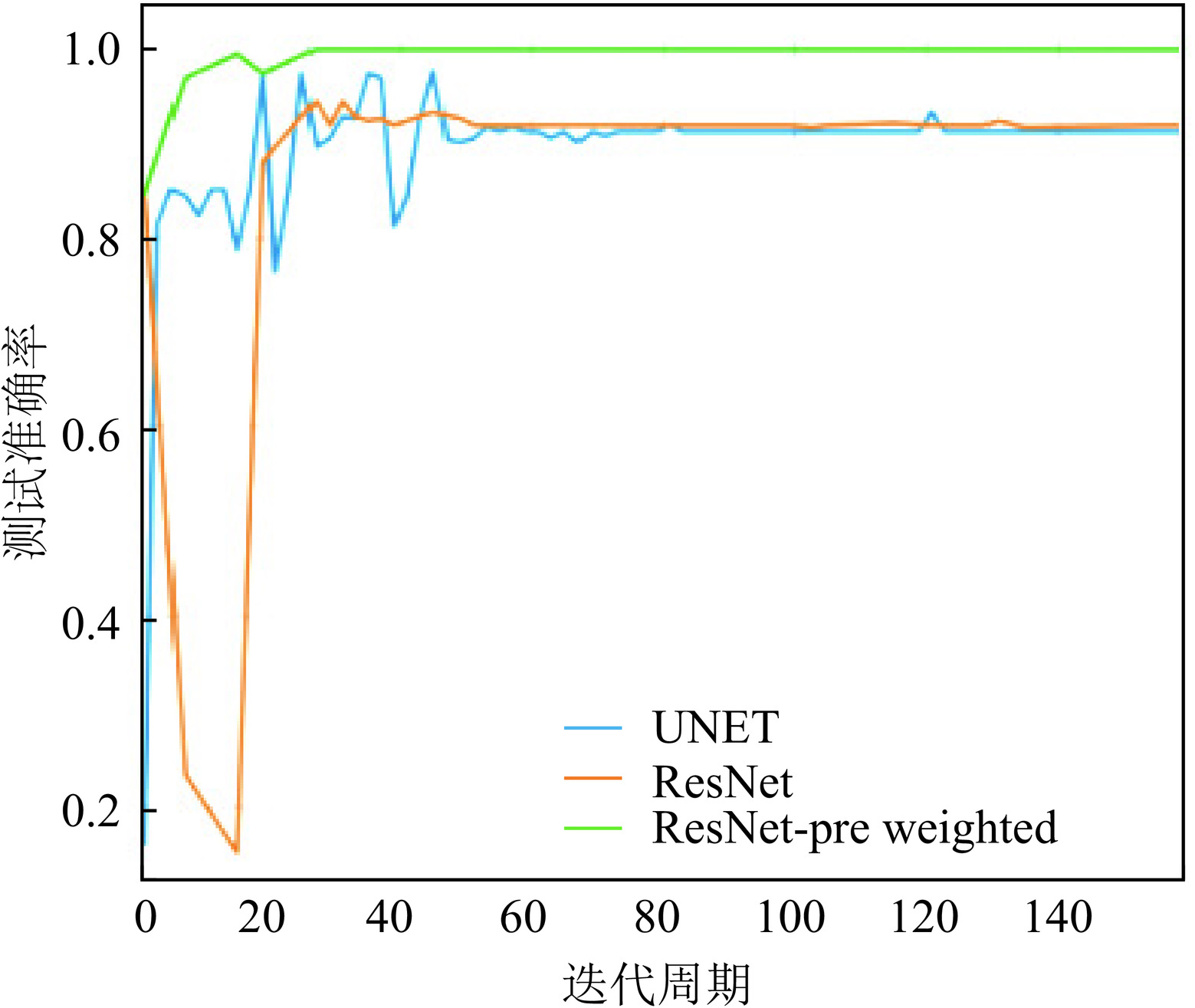

为验证本文提出的

Mylar 膜破损检测方法的抗噪能力,在采集CT 数据时将帧间合并数改为1(原始设置为6),并保持曝光时间等其他条件不变,再进行扫描重建,获得较高噪声的图像样本如图10所示。利用前述训练好的模型对这些高噪声样本进行预测,结果如图11所示。图中灰度值表示预测为破损的概率,其中白色区域(概率接近

1 )表示高置信度的破损区域,黑色区域(概率接近0 )表示完好区域。从预测结果可以看出,即使在较大噪声干扰下,模型对于Mylar膜破损的分类依然保持较高的准确性,这证实该方法具有良好的抗噪声性能。本文实验训练之前,

ResNet34 模型加载了较大规模数据集上的预训练参数,利用了迁移学习技术(图12),这使得预测准确率显著提升。此外,本文也测试了其他模型的分类效果,在

UNet 模型上的预测准确率仅有91%,这与未加载预训练参数的ResNet34 模型表现一致。值得注意的是,当使用未经MSR 对比度增强的数据进行训练和测试时,ResNet34 的预测准确率也仅为86%,远远未达到预期要求,这验证了图像对比度增强处理的必要性。本文检测方法的关键点是对图像进行预处理,通过对比度增强来提升分类效果。从模型对比实验的预测结果来看,这种方法显著提高了分类性能。然而,对比度增强算法在检测过程中占据了大部分时间,处理一张483×512大小的图像大约需要0.3 s对比度增强和0.02 s网络分类,这也成为该方法的一个局限。在未来的工作中,我们计划将对比度增强功能集成到网络模型中,以优化整体检测流程。

4. 结论

本文针对方形带壳锂电池

Mylar 膜破损的特征和实际检测需求,提出一种基于CT 扫描的锂电池Mylar 膜破损智能检测方法。通过系统实验验证,该方法具有以下优点:①具有较高的检测精度,通过对

CT 重建图像进行切片分割和对比度增强预处理,结合深度学习分类模型,显著提升了模型性能,实现了对Mylar 膜破损缺陷的高效、准确检测,准确率达到99.5%以上;②具有良好的抗噪性,即使在较高噪声水平下仍能保持稳定的检测效果,表现出较强的鲁棒性。实验结果表明,本文提出的方法能够满足实际生产中对锂电池

Mylar 膜破损的自动化检测需求,具有较好的工程应用价值。 -

表 1

Mylar 膜破损的智能检测算法Table 1 Intelligent detection method for

Mylar film damage算法 1 Mylar膜破损的智能检测算法 1: 数据采集与重建:利用X射线CT扫描系统对锂电池进行扫描,采集投影图像序列,并通过三维重建算法得到高精度三维断层图像。 2: 切片提取与预处理:从断层图像中提取平行于Mylar膜方向的大面切片图像。对所选切片进行图像预处理,包括数据量化、对比度增强等操作,以突出Mylar膜破损特征。 3: 深度学习分类:基于预处理后的切片图像,选择神经网络进行特征提取和分类。 表 2 MSR对比度增强算法

Table 2 MSR contrast enhancement algorithm

算法 2 MSR(Multi-Scale Retinex)对比度增强算法 输入:图像I(x,y),高斯函数的尺度参数σ1,σ2,⋯,σN。 输出:对比度增强后的图像Ienhence(x,y)。 1. 对数域变换:I′(x,y)=logI(x,y)。 2. Ln(x,y)=Gn(x,y)∗I′(x,y),(n=1,2,⋯,N)。 3. Rn(x,y)=I′(x,y)−Ln(x,y)。 4. R(x,y)=∑Nn=1wnRn(x,y),其中∑Nn=1wn=1。 5. Ienhence(x,y)=RESIZE(exp(R(x,y)))。 注:Ln(x,y)为光照分量的估计值,Gn(x,y)为不同尺度σn的高斯函数,Rn(x,y)为每个尺度下的反射率估计值。RESIZE(⋅)为线性拉伸算子,第5步表示对R(x,y)进行指数变换并线性拉伸至原始图像范围得到对比度增强后的图像Ienhence(x,y)。 表 3 锂电池

CT 扫描重建条件Table 3 CT scanning and reconstruction conditions for lithium batteries

参数名称 参数值 电压 150 kV 电流 400 μA 曝光时间 0.05 s 帧间合并数 6 扫描角度 360° 扫描角度间隔 0.2° 探测器单元尺寸 0.15 mm×0.15 mm 探测器单元个数 2048 ×2048 射线源到旋转中心的距离 100 mm 射线源到探测器的距离 545 mm 重建图像尺寸 27.5 μm×27.5 μm×27.5 μm 重建图像体素个数 1140 ×1448 ×1536 表 4 数据集信息

Table 4 Dataset information

项目 训练集 验证集 测试集 总计 图像总数量 760 380 380 1520 破损样本数量 12 6 6 24 过采样的破损样本数量 360 60 0 420 -

[1] 何阳, 周永涛, 胡彬, 等. 一种导热阻燃型锂电池麦拉膜、其制备方法及高安全锂电池: CN202410802021.9[P]. 2024-10-22. [2] BAK S M, SHADIKE Z, LIN R, et al. In situ/operando synchrotron-based X-ray techniques for lithium-ion battery research [J]. NPG Asia Materials, 2018, 10: 563-580. DOI: 10.1038/s41427-018-0056-z.

[3] 田君, 田崔钧, 王一拓, 等. 锂离子电池安全性测试与评价方法分析[J]. 储能科学与技术, 2018, 7(6): 1128-1134. DOI: 10.12028/j.issn.2095-4239.2018.0154. TIAN J, TIAN C J, WANG Y T, et al. Safety test and evaluation method of lithium ion battery[J]. Energy Storage Science and Technology, 2018, 7(6): 1128-1134. DOI: 10.12028/j.issn.2095-4239.2018.0154. (in Chinese).

[4] 刘峰, 魏思伟, 蒋治亿, 等. 锂电池用 Mylar膜、锂电池和电子产品: CN202321619548.5[P]. 2024-02-06. [5] 刘大同, 周建宝, 郭力萌, 等. 锂离子电池健康评估和寿命预测综述[J]. 仪器仪表学报, 2015, 36(1): 1-16. LIU D T, ZHOU J B, GUO L M, et al. Survey on lithium-ion battery health assessment and cycle life estimation[J]. Chinese Journal of Scientific Instrument, 2015, 36(1): 1-16. (in Chinese).

[6] 王卓, 许江华, 张志勇, 等. 一种锂电池 Mylar膜缺陷检测方法: CN202210200989.5[P]. 2022-07-01. [7] 易凯, 钟鹏, 谢晏武, 等. 一种锂电池包 Mylar膜检测方法及检测系统, CN202111425784.9[P]. 2022-03-04. [8] HEENAN T M M, TAN C, WADE A J, et al. Theoretical transmissions for X-ray computed tomography studies of lithium-ion battery cathodes[J]. Materials & Design, 2020, 191: 108585. DOI: 10.1016/j.matdes.2020.108585.

[9] ALFRAHEED M I. A review of measurement methods for lithium-based battery defect and degradation analysis[J]. International Journal of Modelling and Simulation, 2025: 1-19. DOI: 10.1080/02286203.2025.2479667.

[10] 葛春平, 李育林, 曹琪. X射线检测在叠片式锂离子电池生产中的应用[J]. 电池, 2014, 44(4): 232-234. DOI: 10.3969/j.issn.1001-1579.2014.04.014. GE C P, LI Y L, CAO Q. Application of X-ray detection on laminated Li-ion battery production[J]. Battery Bimonthly, 2014, 44(4): 232-234. DOI: 10.3969/j.issn.1001-1579.2014.04.014. (in Chinese).

[11] 葛春平, 李育林, 薛渭萍, 等. 叠片式锂离子电池在线快速CT检测技术[J]. 电池, 2024, 54(3): 390-394. DOI: 10.19535/j.1001-1579.2024.03.020. GE C P, LI Y L, XUE W P. On-line rapid CT detection technology for laminated Li-ion battery[J]. Battery Bimonthly, 2024, 54(3): 390-394. DOI: 10.19535/j.1001-1579.2024.03.020. (in Chinese).

[12] KRIZHEVSKY A, SUTKEVER I, HINTON G E. ImageNet classification with deep convolutional neural networks[J]. Association for Computing Machinery, 2017, 60(6): 84-90. DOI: 10.1145/3065386.

[13] SIMONYAN K, ZISSERMAN A. Very deep convolutional networks for large-scale image recognition[J]. ArXiv, 2014. DOI: 10.48550/arXiv.1409.1556.

[14] SZEGEDY C, LIU W, JIA Y Q, et al. Going deeper with convolutions[C]//2015 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 2015: 1-9. DOI: 10.1109/CVPR.2015.7298594.

[15] HE K M, ZHANG X Y, REN S, et al. Deep residual learning for image recognition[C]//2016 IEEEConference on Computer Vision and Pattern Recognition (CVPR), 2016: 770-778. DOI: 10.1109/CVPR.2016.90.

[16] HUANG G, LIU Z, MAATEN L V D, et al. Densely connected convolutional networks[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 2017, 2261-2269. DOI: 10.1109/CVPR.2017.243.

[17] DOSOVITSKIY A, BEYER L, KOLESNIKOV A, et al. An image is worth 16×16 words: Transformers for image recognition at scale[J]. ArXiv, 2020. DOI: 10.48550/arXiv.2010.11929.

[18] REN S Q, HE K M, GIRSHICK R, et al. Faster R-CNN: Towards real-time object detection with region proposal networks[C]//IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(6): 1137-1149. DOI: 10.1109/TPAMI.2016.2577031.

[19] REDMON J, DIVVALA S, GIRSHICK R, et al. You only look once: Unified, real-time object detection[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 2016: 779-788. DOI: 10.1109/CVPR.2016.91.

[20] WANG C Y, BOCHKOVSKIY A, LIAO H Y M. YOLOv7: Trainable bag-of-freebies sets new state-of-the-art for real-time object detectors[C]//2023 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), 2023: 7464-7475. DOI: 10.1109/CVPR52729.2023.00721.

[21] AI Y, YE T D. Surface defect detection algorithm for PCB based on improved YOLOv8[C]//2024 8th International Conference on Electrical, Mechanical and Computer Engineering (ICEMCE), 2024: 1421-1425. DOI: 10.1109/ICEMCE64157.2024.10862076.

[22] RONNEBERGER O, FISCHER P, BROX T. U-Net: Convolutional networks for biomedical image segmentation[C]//Medical Image Computing and Computer-Assisted Intervention, 2015: 234-241. DOI: 10.48550/arXiv.1505.04597.

[23] BADRINARAYANAN V, KENDALL A, CIPOLLA R. SegNet: A deep convolutional encoder-decoder architecture for image segmentation[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(12): 2481-2495. DOI: 10.1109/TPAMI.2016.2644615.

[24] ZHAO H S, SHI J P, QI X J, et al. Pyramid scene parsing network[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 2017: 6230-6239. DOI: 10.1109/CVPR.2017.660.

[25] LAND E H, MCCANN J J. Lightness and retinex theory[J]. Journal of the Optical Society of America, 1971, 61(1): 1-11. DOI: 10.1364/josa.61.000001.

[26] PETRO A B, SBERT C, MOREL J M. Multiscale retinex[J]. Image Process on Line, 2014: 71-88. DOI: 10.5201/ipol.2014.107.

[27] PAN S J, YANG Q. A survey on transfer learning[J]. IEEE Transactions on Knowledge and Data Engineering, 2010, 22(10): 1345-1359. DOI: 10.1109/TKDE.2009.191.

[28] YOSINSKI J, CLUNE J, BENGIO Y, et al. How transferable are features in deep neural networks[J] Advances in Neural Information Processing Systems (NIPS), 2014: 27. DOI: 10.48550/arXiv.1411.1792.

[29] 郑远攀, 李广阳, 李晔. 深度学习在图像识别中的应用研究综述[J]. 计算机工程与应用, 2019, 55(12): 20-36. DOI: 10.3778/j.issn.1002-8331.1903-0031. ZHENG Y P, LI G Y, LI Y. Survey of application of deep learning in image recognition[J]. Computer Engineering and Applications, 2019, 55(12): 20-36. DOI: 10.3778/j.issn.1002-8331.1903-0031. (in Chinese).

[30] WANG G, LIN T H, CHENG P, et al. A general cone-beam reconstruction algorithm[J]. IEEE Transactions on Meical Imaging, 1993, 12(3): 486-496. DOI: 10.1109/42.241876.

下载:

下载: